Кодировки же (например UTF-8, KOI8-R) это стандарты преобразования

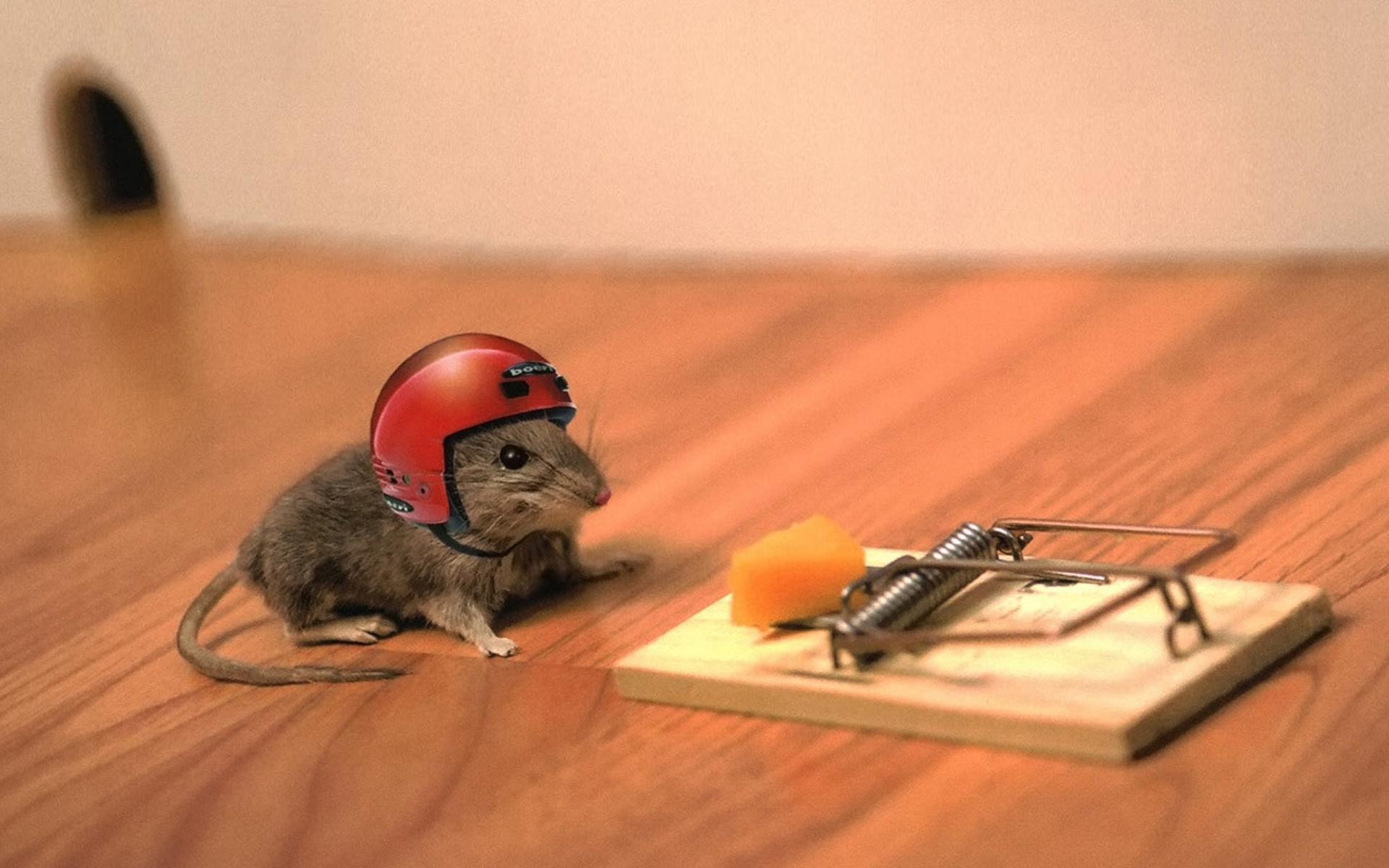

так.. давайте таки не путаться в терминологии ![]()

UNICODE - стандарт

UTF-8, 16,7 и иже с ними - кодировки по стандарту UNICODE

это не преобразование, а тупое сопоставление кода символа, к примеру, 0x0430 = "А".. все и никаких преобразований

в старших системах, по умолчанию, все приложения должны работать с таблицей UNICODE - это довольно жесткая рекомендация MS, где-то в MSDN я это видела..

если вдруг оказывается, что приложение таки UNICODE не поддерживает, то тогда настройка, скрин которой вы приводите, позволяет вручную выбрать нужный язык для приложений, неподдерживающих UNICODE(при этом эта системная настройка никак не будет влиять на кодировку содержимого файлов, хранящегося где-то там на диске..).

так?

теперь по поводу вопроса пользователя...

если я правильно поняла ваше предложение, ему следует самому написать утилитку, которая возьмет коды из его файлов и сопоставит их к UNICODE?

так?

Полезны они в интернетах, т.к. позволяют часть текста (английский, пробелы, цифры и спецсимволы) передавать в 1 байт, а все остальное 2-мя, 3-мя и т.д. имеем экономию трафика.

![]()

нет!

отдельный, передающийся или хранящийся блок текста(где бы он ни был - в интернетах ли, на диске ли и еще где там..) всегда находится в одной какой-то кодировке, ровно до того момента, пока хозяин текста не решит ее сменить.. представлять часть текста кодировкой в 1 байт, другую часть текста в 2 байта - это какой-то изврат, простите...хотя, да, можно и так, конечно, изгалиться..

сколько байт используется под символом зависит от кодировки..

Войти

Войти Регистрация

Регистрация

Наверх

Наверх